논문 링크 : https://arxiv.org/abs/1706.02690

Enhancing The Reliability of Out-of-distribution Image Detection in Neural Networks

We consider the problem of detecting out-of-distribution images in neural networks. We propose ODIN, a simple and effective method that does not require any change to a pre-trained neural network. Our method is based on the observation that using temperatu

arxiv.org

해당 논문은 OOD detection의 시초인 baseline 논문 이후에 새로운 detection method를 제안하는 논문으로, OOD detection 분야의 milestone 논문 중 하나이다.

- Introduction

최근 인공지능 vision task에 있어서, 이미 잘 봤던 train data 뿐만 아니라, test 단계에서 보지 못했던 out-of-distribution data에 대해 잘 recognition할 중요성이 대두 되고있다. 기존의 baseline 논문에서는 잘 학습된 Nerual Network의 softmax probability 값을 사용하여 OOD를 detection하는 방법과 당위성을 보여주며, 해당 방법은 in-distribution에 대한 example의 softmax probability가 OOD data보다 상대적으로 높다는 점에서 착안한다.

해당 논문에서는 out과 in distribution data의 prediction probability의 gap을 더 높이기 위해서 temperature scaling과 small controlled perturbation 방법을 추가적으로 제안한다. 본 논문의 contribution은 다음과 같다.

1. 본 논문은 간단하고 효과적인 ODIN(Out-of-DIstribution detector for Neural networks) 방법을 제안한다. 해당 방법은 neural network에 대해 re-training을 요구하지 않으며, 쉽게 구현이 가능하다.

2. 본 논문에서는 ODIN을 SOTA network architecture에서 test 하고, baseline을 상당히 개선하였음을 보여준다.

3. 해당 방법에 대한 직관과 파라미터 셋팅에 대한 분석을 실험적으로 보여준다.

- ODIN : Out-Of-Distribution Detector

ODIN은 temperature scaling과 input processing으로 구성된다.

Temperature Scaling

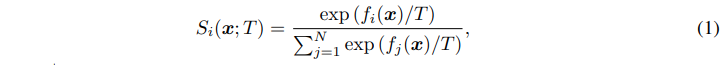

Temperature scaling 방법은 기존의 knowledge distillation과 confidence calibration에서 사용했던 방법을 그대로 이용하였으며, 해당 방법을 OOD detection에 사용하게 되면, out과 in distribution의 softmax probability를 분리하는데 도움이 된다고 한다.

Input Preprocessing

ODIN은 입력 데이터에 대한 식(2)의 전처리 과정을 거치며, 해당 방법은 기존의 adversarial example에 대한 방법을 사용한다. 식(2)의 x 뒤의 마이너스를 +로 바꾸면 기존의 adversarial 식과 같다. 해당 식을 통해 x를 업데이트 하며, 기존의 adversarial에서는 perturbation을 추가하여 true에 대한 sofmax를 감소시켰지만, 해당 논문에서는 이와 반대로 preterbation을 빼서 softmax score를 증가시킨다. 해당 방법은 out-of-distribution보다 in-distribution에 더 강한 효과를 주어, OOD detection 성능 향상에 기여한다.

Out-of-distribution Detector

inference 단계에 위의 두 가지 방법을 적용하여 데이터를 통과시킨다. 해당 데이터를 통과시킨 max probability를 p라 할때, 해당 값이 threshold 델타와 비교하여 p가 더 크면 in-distribution, 작으면 out-distribution으로 간주한다.

- Experiments

위의 표에 있는 2개의 아키텍쳐 각각에서 CIFAR-10, 100에 대해 사전학습을 수행했으며, C-10은 CIFAR-10, C-100은 CIFAR-100에 대한 test error rate를 나타낸다.

위의 표는 CIFAR-10,100으로 학습된 네트워크에 대해 각각의 Out-of-distribution dataset을 사용했을 경우의 성능을 나타낸다. 화살표는 아래로 향하면 낮을수록, 위로 향하면 높을수록 좋은 성능을 의미한다. 모든 성능 지표에 대해서 baseline의 성능을 상당히 개선하였음을 실험적으로 보여주고 있다.

위의 그래프는 실험에서 사용한 ODIN의 하이퍼파라미터 T=1000, 입실론을 0.0012로 했을 경우, TinyImageNet(crop)을 test data로 사용하여 실험한 결과를 나타낸다. 파란색으로 칠해진 면적 만큼 AUROC 성능을 개선하였고, TPR 0.95 일때, FPR을 상당히 줄였음을 보여주고 있다.

이상 추가적인 discussion 및 appendix는 논문을 참고할 수 있다.